みなさま、こんにちは。おくむら(@nori_broccoli)です。

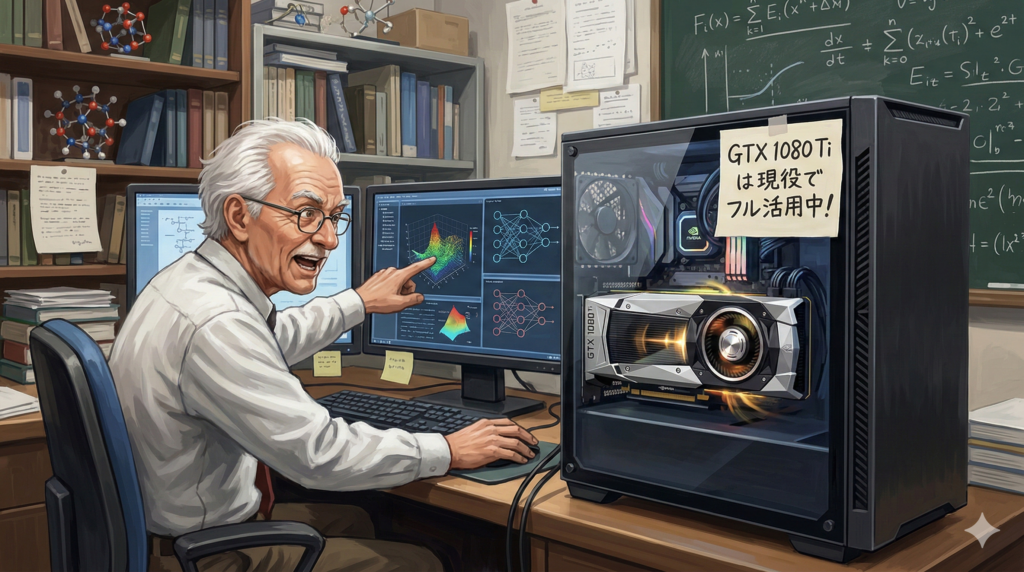

私の研究室はそんなに強い研究室ではないので、最近の高価なGPUサーバを購入することは難しいのですが、7年選手になるGTX 1080 Tiが4枚載ったサーバが現役で頑張っています。実はこの人結構優秀で、1枚のGPUに11GBのRAMが載っているから、4枚あれば70Bのモデルも載るんですよね。もちろん、今のGPUみたいにテンソルコアがあるわけでもなく、SLIで繋いでいるわけでもないから爆速マシンというわけにはいかないですが、それでも、6〜7T/sぐらいのペースで応答してくれるので、ChatGPTやGeminiに慣れている人なら、まぁそこまで遅いとは思わないかな?ぐらいのペースで応答してくれます。

結構半信半疑なところがあったんですが、Geminiさんとサーバの復旧作業をしていて、このサーバなら70Bも動かせるよね〜!なんてことを言われたのが話の始まりでした。Ubuntu24.04LTSで稼働させていたのですが、何かの拍子にカーネルパニックを起こしてしまって戻ってこなくなってしまったんですよね。元々Ubuntuがそんなに好きではないということもあって、どうせなら愛着のあるDebianにしてしまえ!って思ったのがスタートラインです。

実際Debianを入れて良かったなって思っています。本当に無駄なものは一切入れずに、ただ黙々と計算だけをするマシンができましたから、無駄なリソース一切食っていない快適環境になりました。そのうえで、70Bのモデルが載ると言われたら遊ばないわけにはいきません。

早速Llamaの70Bモデルを試したところ、本当にさくっとメモリに載ってしまって、普通にチャットできる状態になって拍子抜けしながらも感動しています。やはり、VRAMが11GBあるというのが大きくて、Llamaは42GBぐらいだから4分割すると載るんですよね。SLI組んでいないのでGPU間の通信でボトルネックが発生するのは仕方ないとしても、7T/sぐらい出てくれるなら全然OKです。今頃のラップトップのRTX5090より下手すると早いですから。デスクトップ機には当然負けます。それでも、単体だったらせいぜい30T/sぐらいだし、許容範囲でしょう。

ちょっとした予算がつきそうなので、それを使ってeGPUとして動作させたらいいかなとかいろいろ考えてはいます。Blackwell?だかなんだか、手元に1台はほしいですよね・・・と思いつつも、息を吹き返した愛着のある7年選手とまだまだ頑張っていきますよ!